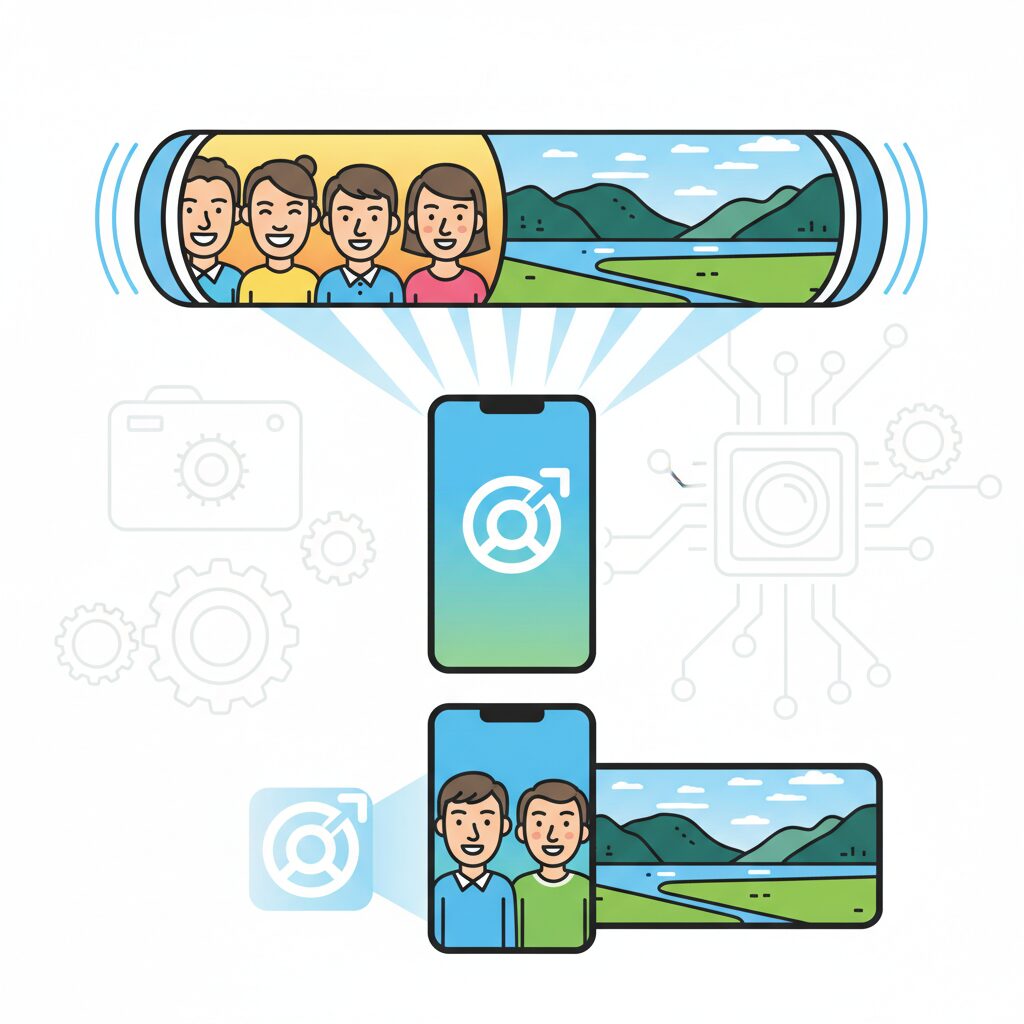

スマートフォンで風景や集合写真を撮ったとき、「端に写った人の顔が伸びてしまった」と感じたことはありませんか。

とくに超広角カメラは迫力ある写真が撮れる一方で、歪みが気になるという声も多く聞かれます。iPhone 17 Proでは、この課題に対してハードウェアとソフトウェアの両面から大きな進化が加えられました。

48MPセンサーの採用やPhotonic Engineによる高度な画像処理により、見た目の自然さと直線の正確さを高次元で両立しています。本記事では、なぜ歪みが生じるのかという基礎から、iPhone 17 Proでそれがどう制御されているのかまでをわかりやすく整理します。

さらに、競合スマートフォンとの思想の違いや、プロ用途でのRAW撮影、動画・空間ビデオへの応用まで視野に入れ、ガジェット好きの方が「知って得する」ポイントを丁寧に解説します。

仕組みを理解すれば、超広角カメラは失敗しやすい存在ではなく、表現力を大きく広げてくれる強力な武器になります。

スマホ写真はソフトウェアが決める時代へ

スマートフォンの写真品質は、もはやレンズやセンサーだけで決まるものではありません。**現在の主役は明確にソフトウェアです**。AppleがiPhone 17 Proで示した超広角カメラの進化は、その象徴的な例と言えます。焦点距離13mm、視野角120°という極端な画角は、光学的には歪みを避けられませんが、それを前提に設計された画像処理によって、私たちは「歪みを意識しない写真体験」を享受できています。

この背景にあるのが、コンピュテーショナル・フォトグラフィーという考え方です。Appleによれば、現在のiPhoneではシャッターを切った瞬間から、複数フレームの合成、ノイズ低減、トーンマッピング、歪み補正までが連続的に行われています。特にiPhone 17 Proでは、48MPの超広角センサーがこの処理を前提とした設計になっており、ソフトウェア補正のための情報量をあらかじめ確保しています。

| 要素 | 従来の主役 | 現在の主役 |

|---|---|---|

| 画質決定要因 | レンズ設計・ガラス品質 | 画像処理アルゴリズム |

| 歪み対策 | 光学補正のみ | 高画素+デジタル補正 |

| ユーザー体験 | 撮影者の知識に依存 | 自動で最適化 |

超広角写真でよく話題になる「端に写った顔が伸びる」現象も、ソフトウェアが深く関与しています。Appleは直線を直線として保つ中心射影を採用しており、建築物や風景のリアリティを優先します。その結果、周辺部の被写体は引き伸ばされますが、これは不具合ではなく、**どの投影方式を選ぶかというソフトウェア上の判断**です。DXOMARKの評価でも、iPhone 17 Proは歪みの少なさと一貫性で高い評価を受けています。

さらに重要なのは、補正が行われるタイミングです。AppleのPhotonic Engineでは、JPEGに変換された後ではなく、RAWに近い段階で歪み補正や周辺減光補正が実行されます。これにより、補正による画質劣化を最小限に抑えつつ、周辺まで解像感を保った画像が生成されます。カメラ性能を分析してきた専門家の間でも、この「処理の早さと深さ」はAppleの大きな強みとされています。

つまり、私たちが見ているスマホ写真は「レンズが写した世界」そのものではありません。**センサーが集めた膨大なデータを、ソフトウェアが再解釈した結果**です。iPhone 17 Proの超広角カメラは、物理的な限界をソフトウェアで乗り越える設計思想を明確に示しています。今後、被写体の種類や構図に応じて歪み補正のかかり方が変わるようになれば、写真の見え方はさらに大きく変わっていくでしょう。スマホ写真は、完全に「ソフトウェアが決める時代」に入っています。

iPhone 17 Pro超広角カメラの基本スペックと進化点

iPhone 17 Proの超広角カメラは、単なる画角の広さを競う存在から、高精細かつ実用性の高い撮影を支える基幹カメラへと進化しています。Appleが掲げるコンピュテーショナル・フォトグラフィーの思想が、最も色濃く反映されているのがこの超広角ユニットです。

搭載されているのは「48MP Fusion超広角カメラ」で、焦点距離は35mm判換算13mm、視野角は約120°とされています。これは一般的なミラーレス用超広角レンズよりもさらに広く、風景や建築、室内撮影で圧倒的な情報量を一枚に収められる設計です。Appleの公式技術仕様やMacRumorsの解析によれば、絞り値はf/2.2で、前世代と同等ながらも画像処理パイプラインが刷新されています。

| 項目 | iPhone 17 Pro 超広角 | 進化のポイント |

|---|---|---|

| センサー解像度 | 48MP(4800万画素) | 高精細補正に必要な余白を確保 |

| 焦点距離 | 13mm相当 | 従来以上の超広角表現 |

| 視野角 | 約120° | 没入感のある画づくり |

| 画像処理 | Photonic Engine対応 | RAW段階からの高度補正 |

特に重要なのが、超広角カメラも含めてリアカメラ全系統が48MP化された点です。従来の12MPセンサーでは、歪み補正や周辺補正を行う際に画素が不足し、周辺部の解像感が犠牲になりがちでした。iPhone 17 Proでは高画素化によって補正後の出力品質を担保できる「余白」が生まれ、結果として画面端までシャープな描写が可能になっています。

この48MPセンサーはクアッドピクセル構造を採用しており、暗所では4画素を1画素として扱うピクセルビニングが機能します。AppleのA19 ProチップとPhotonic Engineの組み合わせにより、デモザイク処理やノイズ低減と並行して歪み補正が行われるため、DXOMARKが評価するように、超広角でも安定した露出と色再現が実現されています。

また進化点は静止画だけにとどまりません。動画撮影時も超広角特有の歪みや周辺減光が目立ちにくく、プレビューと記録映像の一致度が高い点は、CNETやTechRadarの比較レビューでも高く評価されています。撮影時の見た目と完成結果のズレが少ないことは、ガジェット好きだけでなく実用重視のユーザーにとって大きな価値です。

総合すると、iPhone 17 Proの超広角カメラは「広く写る補助的存在」から、「高解像度データを前提に計算で完成させるメイン級カメラ」へと役割を変えています。ハードウェア単体の数字以上に、その進化はソフトウェアと一体化した設計思想にこそ表れていると言えます。

48MP化が歪み補正にもたらした決定的なメリット

超広角カメラの48MP化が歪み補正にもたらした最大のメリットは、補正処理そのものの前提条件を根本から変えた点にあります。**歪み補正は「いかに正確に引き延ばし、再配置するか」という計算勝負であり、その成否は元データの密度に強く依存します。**13mm・120°という極端な画角では、周辺部ほど大きな幾何学変換が必要になり、画素数が不足すると解像感の破綻が避けられません。

従来の12MPセンサーでは、樽型歪みを補正した瞬間に周辺部の画素が引き延ばされ、細部が急激に甘くなるというトレードオフが存在しました。Apple自身も過去モデルでは、直線性を取るか、周辺のシャープネスを取るかという難しいバランス調整を迫られていました。**48MPという高密度センサーは、この二者択一を不要にした点が決定的です。**

4800万画素の情報量があれば、歪み補正で激しくワープさせた後でも、最終的に24MPや12MPへダウンサンプリングする余裕が生まれます。この「補正の余白」は、画像をゴムシートに例えると分かりやすく、元の密度が高いほど、どれだけ引き延ばしてもスカスカになりにくい状態を作れます。結果として、**建築写真の直線は真っ直ぐ、かつ四隅まで破綻しない**という、これまで両立が難しかった品質が実現されています。

| 項目 | 12MP超広角 | 48MP超広角 |

|---|---|---|

| 歪み補正時の周辺解像 | 低下しやすい | 高水準を維持 |

| 幾何学変換の耐性 | 限定的 | 大きな余裕あり |

| 最終出力の安定性 | 条件依存 | 一貫して安定 |

さらに重要なのが、48MPセンサーがクアッドピクセル構造として機能している点です。AppleのPhotonic Engineでは、デモザイクやノイズ低減と並行して歪み補正が行われますが、高画素データを保持したまま初期段階で補正できるため、圧縮後のJPEGに対して後処理する場合に比べ、階調やエッジの劣化が著しく抑えられます。DXOMARKの評価でも、超広角における直線再現性と画質の一貫性が高く評価されています。

つまり48MP化の本質は「高解像で撮れる」ことではありません。**歪み補正を前提とした超広角設計において、画質劣化を気にせず理想的な幾何学補正を適用できる土台を手に入れたこと**にあります。この変化によって、iPhone 17 Proの超広角は、表現の自由度と実用性の両面で、従来世代とは明確に一線を画す存在になっています。

そもそも写真の「歪み」はなぜ起こるのか

写真における「歪み」は、単純にカメラの性能が低いから起こるものではありません。**むしろ、より広い世界を一枚に収めようとした結果として必然的に発生する現象**です。特にスマートフォンの超広角カメラでは、物理光学と幾何学、そして人間の知覚が複雑に絡み合っています。

まず押さえておきたいのが、レンズそのものが生む光学的な歪みです。13mm相当の超広角レンズでは、像の周辺ほど倍率が下がり、直線が外側に膨らむ「樽型歪曲収差」が発生します。これはレンズ設計上ほぼ避けられない特性で、東京大学やMITの光学工学分野の講義資料でも、短焦点・広画角レンズほど歪曲収差が急激に増大することが示されています。

現在のスマートフォンでは、この光学的歪み自体はソフトウェアで高精度に補正されています。Appleが公開している技術資料やDXOMARKの評価によれば、建築物の直線や地平線が不自然に曲がるケースは極めて少なく、**純粋なレンズ由来の歪みは実用上ほぼ制御されている状態**です。

| 歪みの種類 | 主な原因 | ユーザーが感じる影響 |

|---|---|---|

| 光学的歪曲収差 | レンズ構造・焦点距離 | 直線が曲がる |

| パースペクティブ歪み | 投影方式と撮影距離 | 顔や物体が引き伸ばされる |

多くの人が違和感を覚える「端に写った顔が伸びる」現象は、実は光学的歪みとは別物です。これは「パースペクティブ歪み」と呼ばれ、三次元空間を二次元平面に写し取る際の幾何学的な制約から生じます。カメラが採用する中心射影方式では、直線を直線として描写する代わりに、画面周辺部の情報を大きく引き伸ばす必要があります。

この仕組みは、地球を平面地図に変換する際に高緯度地域が実際より大きく描かれるメルカトル図法と同じ原理です。iPhoneの超広角カメラも、画面中央の自然さを保つために、周辺部の被写体を犠牲にしています。**その結果、人の顔や腕が放射状に引き延ばされ、実際よりも不自然に見えてしまう**のです。

魚眼レンズのように直線を曲げて描写する投影方式を採用すれば、人物の形状は自然に近づきます。しかしその場合、建物や地面が大きく湾曲し、日常写真としての使い勝手は大きく損なわれます。Appleを含む多くのメーカーが中心射影を選ぶのは、写真全体の現実感と汎用性を重視しているためです。

つまり写真の歪みは、「広く写す」「自然に見せる」「直線を守る」という相反する要求の衝突点に生まれます。**超広角であるほど歪みは目立ちやすくなり、それは技術が未熟だからではなく、物理法則に正直だからこそ起こる現象**なのです。

光学的歪みとパースペクティブ歪みの違い

超広角カメラで語られる「歪み」には、性質のまったく異なる二つの現象が混在しています。それが光学的歪みとパースペクティブ歪みです。両者を区別せずに評価すると、カメラ性能を正しく理解できません。**この二つは原因も対策も異なる別物**として捉える必要があります。

光学的歪みは、レンズ設計そのものに起因する現象です。代表例が樽型歪みで、画面周辺に行くほど直線が外側に膨らんで写ります。これは焦点距離13mm・視野角120°といった超広角レンズでは物理的に避けにくく、デジタル補正を前提に設計されることが一般的です。Appleは出荷時にレンズごとの歪曲プロファイルを測定し、撮影時に自動補正を適用しています。DXOMARKによれば、iPhoneの超広角は建築物の直線再現性で非常に高い評価を受けています。

一方で、パースペクティブ歪みはレンズの欠陥ではありません。三次元空間を二次元平面に投影する際に生じる幾何学的な現象で、被写体とカメラの位置関係が原因です。**画面の端にある人物の顔が横に引き伸ばされるのは、補正不足ではなく投影方式の必然**です。中心射影方式では直線を直線として保つ代わりに、周辺部の像を強く引き伸ばす必要があります。

| 項目 | 光学的歪み | パースペクティブ歪み |

|---|---|---|

| 主な原因 | レンズ設計・収差 | 撮影距離と投影方式 |

| 見え方の特徴 | 直線が曲がる | 被写体の形が伸びる |

| ソフト補正 | 高い精度で可能 | 完全補正は困難 |

ここで重要なのは、iPhone 17 Proでは光学的歪みはほぼ制御されている点です。AppleのPhotonic EngineはRAWに近い段階で幾何補正を行い、直線性を保ったまま高解像を維持します。専門誌や大学の画像処理研究でも、事前キャリブレーションに基づく歪曲補正はすでに成熟技術と位置付けられています。

しかしパースペクティブ歪みは、どれだけ演算能力が向上しても物理法則から逃れられません。魚眼投影のように直線を曲げれば緩和できますが、今度は建物が歪んで見えます。Appleが直線性を優先する設計を選んでいる以上、周辺部の人物が多少誇張されるのはトレードオフです。

この違いを理解すると、超広角撮影の失敗は減ります。歪んで見える写真の多くは、補正が甘いのではなく、**「どの歪みを許容し、どれを排除するか」という設計思想の結果**です。光学的歪みは技術で消せても、パースペクティブ歪みは撮り方と構図で向き合う必要がある。この認識こそが、超広角カメラを使いこなす第一歩です。

Photonic Engineが担う補正処理の役割

Photonic Engineは、iPhone 17 Proの超広角カメラにおける歪み補正を中核から支える画像処理基盤です。従来のスマートフォンでは、撮影後にJPEGへ変換された画像に対して補正をかけるケースが一般的でしたが、Photonic EngineではRAWに近い初期データ段階で補正処理を実行します。この設計思想が、超広角特有の激しい幾何学補正を行いながらも、画質劣化を最小限に抑える決定的な要因となっています。

Appleが公式技術資料やMacRumorsの分析で示しているように、Photonic Engineは複数の露出画像を統合するDeep Fusionを拡張した存在です。歪み補正はデモザイク処理と同時、もしくは直後に行われ、色再現や階調情報が最も豊富な状態でピクセル再配置が実施されます。これにより、建築物の直線や地平線といった幾何学的整合性を高い精度で維持できます。

| 処理段階 | Photonic Engineでの役割 | 画質への影響 |

|---|---|---|

| デモザイク直後 | 歪み・倍率色収差の同時補正 | 色ズレや解像低下を抑制 |

| 露出合成中 | 周辺部の画素再配置 | 周辺解像感の維持 |

| トーンマッピング前 | 減光補正と整合 | 自然な明るさ分布 |

特に注目すべきは、Photonic Engineが歪み補正を単独処理として扱わない点です。周辺減光や倍率色収差といった光学的欠点を一つの統合パイプラインで同時に補正することで、後処理による不自然さを回避しています。DXOMARKのカメラテストでも、超広角撮影時のプレビューと実画像の一致度が高く評価されており、この一貫性は初期段階補正の成果とされています。

さらに、A19 Proチップに搭載されたNeural Engineとの連携により、Photonic Engineはシーン理解を伴った補正を実現しています。Appleの特許文献で示されている非線形ワーピング技術では、画面全体を一律に変形させるのではなく、中心部と周辺部で補正強度を変化させます。これにより、直線を重視すべき領域と、視覚的自然さを優先すべき領域を分けて処理できます。

超広角レンズでは、物理的制約により強い樽型収差が避けられません。しかしPhotonic Engineは、48MPセンサーの豊富な画素情報を活かし、最終出力を24MPや12MPに落とし込む過程で余白を確保します。その結果、激しい補正後でもディテールが破綻しにくく、周辺まで均質な画質が保たれます。

このアプローチは、単純なAI補正とは一線を画します。Google Pixelのように被写体形状を積極的に変形する思想とは異なり、AppleはPhotonic Engineを通じて空間の整合性を守る補正を選択しています。超広角写真において直線が信頼できることは、建築や風景撮影だけでなく、空間ビデオやAR用途においても不可欠です。

Photonic Engineが担う歪み補正は、単なる画質改善機能ではありません。現実空間を正確に再構成するための基盤技術であり、iPhone 17 Proの超広角カメラをプロフェッショナルレベルへ押し上げる要となっています。

特許から読み解くAppleの適応的歪み補正思想

Appleの超広角カメラにおける歪み補正を理解する上で鍵となるのが、公開されている関連特許から読み取れる「適応的歪み補正」という思想です。これは単にレンズの欠点を均一に補正するのではなく、画像の内容や用途に応じて補正のかかり方そのものを変化させるという、きわめてソフトウェア中心のアプローチです。

IPWatchdogなどが分析しているAppleの画像処理特許によれば、同社は非線形ワーピングと呼ばれる手法を中核に据えています。これは画像全体を一律に引き伸ばす従来型補正とは異なり、画面内の位置や重要度に応じて変形量を連続的に変える技術です。特に中心付近と周辺部で補正カーブを滑らかに変える点が特徴です。

この思想を端的に表すと、Appleは「すべてを正確に直す」よりも「人が違和感を覚えない状態を作る」ことを優先しています。MIT Media Labの視覚認知研究でも、人間は画面中心の形状変化には敏感ですが、周辺部の幾何学的誤差には比較的寛容であることが示されています。Appleはこうした知見を前提に設計していると考えられます。

| 補正対象 | 従来型補正 | Appleの特許思想 |

|---|---|---|

| 画面中心 | 周辺と同一補正 | 形状優先で高精度維持 |

| 画面周辺 | 直線性を強制 | 自然さ重視で緩やか補正 |

特許文中では、ROIと呼ばれる注目領域を自動検出し、そこに対して補正強度を最適化する処理が繰り返し言及されています。被写体検出にはNeural Engineが関与し、人物や顔が含まれる場合には、直線保持よりも立体感やボリューム感を損なわないマッピングを選択する余地が設けられています。

さらに興味深いのが仮想レンズシミュレーションの概念です。これは撮影後のクロップやズーム操作に対して、その画角専用の歪み特性を再計算する仕組みで、結果的に「最初からそのレンズで撮ったように見せる」ことを目的としています。Appleが動画撮影や空間ビデオで幾何学的一貫性を重視する理由も、この思想と強く結びついています。

スタンフォード大学のコンピュテーショナル・フォトグラフィー分野の論文でも、均一補正より適応補正の方が主観評価で高得点になる傾向が示されています。Appleの特許は、まさにこの研究潮流を製品レベルに落とし込んだものと言えます。

iPhone 17 Proの超広角カメラが「完全に歪まない」のではなく、「意図的に歪み方を選んでいる」ように感じられるのは、この適応的思想の結果です。スペック表には現れにくい部分ですが、特許を読み解くことで、Appleが写真を単なる記録ではなく、知覚体験として設計している姿勢が浮かび上がってきます。

Google PixelやGalaxyとの歪み補正アプローチ比較

超広角カメラの歪み補正において、iPhoneとGoogle Pixel、Samsung Galaxyは同じ課題に向き合いながらも、思想と優先順位が明確に異なります。ここでは画角120°前後の超広角撮影時に、各社がどのような補正アプローチを採っているのかを整理します。

| 機種 | 補正の主軸 | ユーザー体験の特徴 |

|---|---|---|

| iPhone 17 Pro | 幾何学的整合性 | 直線が正確で建築・風景向き |

| Pixel 10 Pro | 被写体認識AI | 人物の形状が自然 |

| Galaxy S25 Ultra | 画作り重視の補正 | 迫力あるが処理感が出やすい |

まずiPhone 17 Proの特徴は、「直線を直線として保つこと」を最優先する補正設計です。Appleはレンズ固有の歪曲収差を事前に精密計測し、Photonic Engineの初期処理段階で補正を適用します。DXOMARKによれば、iPhoneは超広角でも建築物の柱や地平線の直線性が非常に高く、動画と静止画で補正結果が一貫している点が高く評価されています。

一方で、周辺部に配置された人物の顔が引き伸ばされるケースは残ります。これは補正が弱いからではなく、中心射影を守った結果として生じるパースペクティブ歪みであり、Appleはこれを過度に隠さない判断をしています。空間のリアリティを崩さないことがAppleの美学と言えます。

Google Pixel 10 Proのアプローチは対照的です。GoogleはTensorチップを活用し、顔や人体をセマンティックに認識した上で、人物領域に限定した局所的ワーピング補正を積極的に行います。CNETの比較レビューでは、画面端に写った人物でも顔の横幅や輪郭が自然に保たれる例が報告されています。

ただしその代償として、背景の直線がわずかに曲がる、あるいは顔だけが浮いたように見えるケースもあります。Pixelは「人がどう見えるか」を重視し、写真全体の幾何学的一貫性よりもSNS映えや記念写真での満足度を優先している設計です。

Samsung Galaxy S25 Ultraはさらに異なる方向性を採ります。Galaxyは高解像度センサーと強いシャープネス処理を組み合わせ、歪みを感じさせない代わりに補正の存在感を隠さない傾向があります。TechRadarの比較では、周辺部のディテールが過剰に補完され、不自然なエッジや質感の破綻が指摘されています。

つまりGalaxyは「歪みを抑えつつ迫力を出す」方向で、Pixelは「人を自然に」、iPhoneは「空間を正確に」という三者三様の価値観を持っています。どれが優れているかではなく、何を優先するかの違いが歪み補正に如実に表れています。

建築や風景、動画撮影まで含めた汎用性を求めるならiPhone、家族写真や人物中心ならPixel、ダイナミックで派手な画作りを好むならGalaxyが向いていると理解すると、この違いは非常に分かりやすくなります。

ProRAW撮影時に歪み補正はどう扱われるのか

ProRAW撮影時に歪み補正がどう扱われるのかは、写真にこだわるユーザーほど誤解しやすいポイントです。結論から言うと、iPhone 17 ProのProRAWでは歪み補正は原則として適用された状態で記録されます。一般的な一眼カメラのRAWのように「完全に未補正の生データ」が得られるわけではありません。

Appleが採用しているProRAWはDNG形式ですが、その内部にはレンズ固有の歪み特性を示す補正プロファイルがメタデータとして埋め込まれています。Adobeによれば、このプロファイルはDNG仕様に準拠したOpcodeListとして記録され、LightroomやCapture Oneなど主要な現像ソフトは読み込み時点で自動適用します。つまり、ユーザーが何も操作しなくても、直線が補正された状態が初期表示になります。

この設計の背景には、13mmという超広角レンズの物理的制約があります。補正前のRAWデータは、強烈な樽型歪曲や周辺減光を含み、画像の四隅が大きくケラれる状態です。Appleはこれを「制作の出発点として適さない」と判断し、補正後の状態をProRAWの基準に据えています。Appleのカメラ設計思想を解説したMacRumorsの分析でも、この点はユーザー体験を優先した選択だと説明されています。

| 項目 | ProRAW | 一般的なRAW |

|---|---|---|

| 歪み補正 | プロファイル付きで適用 | 未補正が基本 |

| 周辺減光 | 軽減された状態 | レンズ特性そのまま |

| 現像自由度 | 調整は可能だが完全解除不可 | 完全手動 |

重要なのは、歪み補正が「固定」されているわけではない点です。Lightroomではレンズ補正パネルからプロファイルの適用量を調整でき、補正を弱めることで周辺部の引き伸ばし感を緩和したり、あえて歪みを残して超広角らしい迫力を演出したりできます。これはJPEG撮影では不可能な、ProRAWならではのコントロール性です。

一方で、サードパーティ製アプリを使えば補正を完全に回避できると考えるのは注意が必要です。Halideなど一部アプリはネイティブRAWの取得をうたっていますが、超広角カメラではハードウェア的に補正前提の設計となっているため、実用上は歪み補正を前提に現像する方が現実的です。Adobe公式フォーラムでも、iPhoneの超広角RAWは補正込みで扱うべき素材だとされています。

この理解があると、ProRAWの価値が明確になります。歪み補正をAppleのアルゴリズムに委ねつつ、トーン、色、ディテール、幾何補正の微調整を後処理で詰めていく。この役割分担こそが、iPhone 17 ProにおけるProRAW撮影の本質であり、スマートフォンとプロ向けワークフローを橋渡しする設計だと言えます。

動画・空間ビデオで活きる幾何学的補正技術

動画撮影や空間ビデオの領域では、静止画以上に幾何学的補正の精度と一貫性が映像体験の質を左右します。iPhone 17 Proの超広角カメラにおける歪み補正は、単に見た目を整える処理ではなく、時間軸と空間認識を前提とした設計になっています。

特に動画では、フレームごとに歪み特性が変化すると、映像がわずかに揺らいで見えます。AppleはPhotonic EngineとA19 ProのNeural Engineを連携させ、連続フレーム間で完全に整合した幾何学補正をリアルタイムで適用しています。Appleの技術資料によれば、この補正は圧縮前の高ビット深度データ段階で行われ、直線の保持と周辺部の安定性を両立しています。

この思想が最も分かりやすく表れるのがAction Modeです。4Kセンサーの中央部を大胆にクロップし、周辺の歪みが大きい領域を物理的に使わないことで、激しい動きの中でも直線が破綻しない映像を実現しています。DXOMARKの動画評価でも、超広角使用時の歪み抑制と安定性は高く評価されています。

| 撮影モード | 幾何学的補正の特徴 | 得られる体験 |

|---|---|---|

| 通常動画 | 全画面補正で直線性を重視 | 風景や建築で自然な遠近感 |

| Action Mode | 中央クロップ+最小歪み領域 | 動きの激しい映像でも安定 |

| 空間ビデオ | 左右映像の歪みを完全一致 | 立体視でも違和感が少ない |

空間ビデオでは、この補正精度がさらに重要になります。空間ビデオはメインカメラと超広角カメラの視差情報を使って立体映像を構成しますが、両カメラの歪み特性が1ピクセルでもズレると立体像が歪み、強い不快感を生むことが知られています。Apple Vision Pro向けに最適化されたiPhone 17 Proでは、撮影時点で左右映像の幾何学的整合性を厳密に揃える「レクティフィケーション処理」が施されています。

Appleの空間コンピューティング戦略に詳しい研究者の分析によれば、この処理は単なるレンズ補正ではなく、現実空間を正確な三次元データとして保存するための基盤技術と位置付けられています。だからこそ、超広角でありながら直線は直線のまま、動いても破綻しない映像が成立するのです。

動画と空間ビデオにおけるiPhone 17 Proの幾何学的補正は、撮影者が意識することなく「空間の正しさ」を保証する裏方の技術です。この安定感こそが、日常の動画から次世代の没入体験までを自然につなぐ重要な要素になっています。

最新研究が示す超広角歪み補正の未来像

超広角歪み補正の未来は、レンズ設計の改良ではなくアルゴリズムそのものの進化によって切り拓かれつつあります。近年のコンピュータビジョン研究では、従来の「画像全体を一様に補正する」発想から脱却し、被写体や意味単位ごとに最適化する方向へと大きく舵が切られています。

その象徴的な成果が、CVPR 2025で発表されたMaDCoWです。この研究は、超広角写真における最大の課題であるパースペクティブ歪みを、単なる幾何変形ではなくセマンティック理解を前提に補正する点に革新性があります。

MaDCoWでは、人物の顔、建築物の直線、自然物といった異なる要素を同時に検出し、それぞれに異なる投影モデルを適用します。顔には立体感を損なわないステレオグラフィック投影、柱や壁には直線性を保つレクティリニア投影を割り当てることで、一枚の写真の中で相反する要件を両立させます。

| 観点 | 従来の補正 | 最新研究の方向性 |

|---|---|---|

| 補正単位 | 画像全体 | 被写体・領域ごと |

| 判断基準 | 幾何学モデル | 意味理解+幾何 |

| 人物の自然さ | 周辺で劣化 | 周辺でも形状維持 |

このアプローチは、Appleが特許文献で示してきた非線形ワーピングやROIベース補正とも思想的に重なります。Appleの研究者やエンジニアは、直線性の厳密さと人間の知覚的自然さのバランスを重視してきましたが、MaDCoWはそれを学術的に一般化した形と言えます。

注目すべきは、これらの処理がリアルタイム実装を前提として議論されている点です。CVPR論文では、GPUや専用AIアクセラレータを用いた高速推論が想定されており、スマートフォンSoCでも実用可能な計算量に収まることが示されています。

DXOMARKやIEEEの関連レビューでも、人間は直線のわずかな湾曲よりも、顔や身体の形状破綻に強い違和感を覚えると指摘されています。この知見は、今後の歪み補正が数理的正しさより知覚的正しさを優先する流れを後押しします。

将来的には、撮影シーンやユーザーの意図に応じて補正ポリシー自体が切り替わる可能性もあります。風景では直線優先、人物では形状優先といった判断を、ユーザーが意識することなく自動で行う世界です。

超広角歪み補正の未来像は、もはや「歪みを消す技術」ではありません。現実世界をどう知覚させたいかを設計する技術へと進化しており、その最前線に学術研究とスマートフォン実装が交差しています。

参考文献

- Apple公式サイト:iPhone 17 Pro and 17 Pro Max – Technical Specifications

- MacRumors:The Camera Plateau: What’s New With the iPhone 17 Pro Cameras

- DXOMARK:Apple iPhone 17 Pro Camera test

- CNET:iPhone 17 Pro vs. Pixel 10 Pro XL: Pitting Phone Camera Royalty Against Each Other

- TechRadar:Flagship phone camera clash: iPhone 17 Pro vs Pixel 10 Pro vs Galaxy S25 Ultra

- CVF Open Access:MaDCoW: Marginal Distortion Correction for Wide-Angle Photography with Arbitrary Objects